研究紹介

注意機構を持った深層ニューラルネットワークの勾配探索

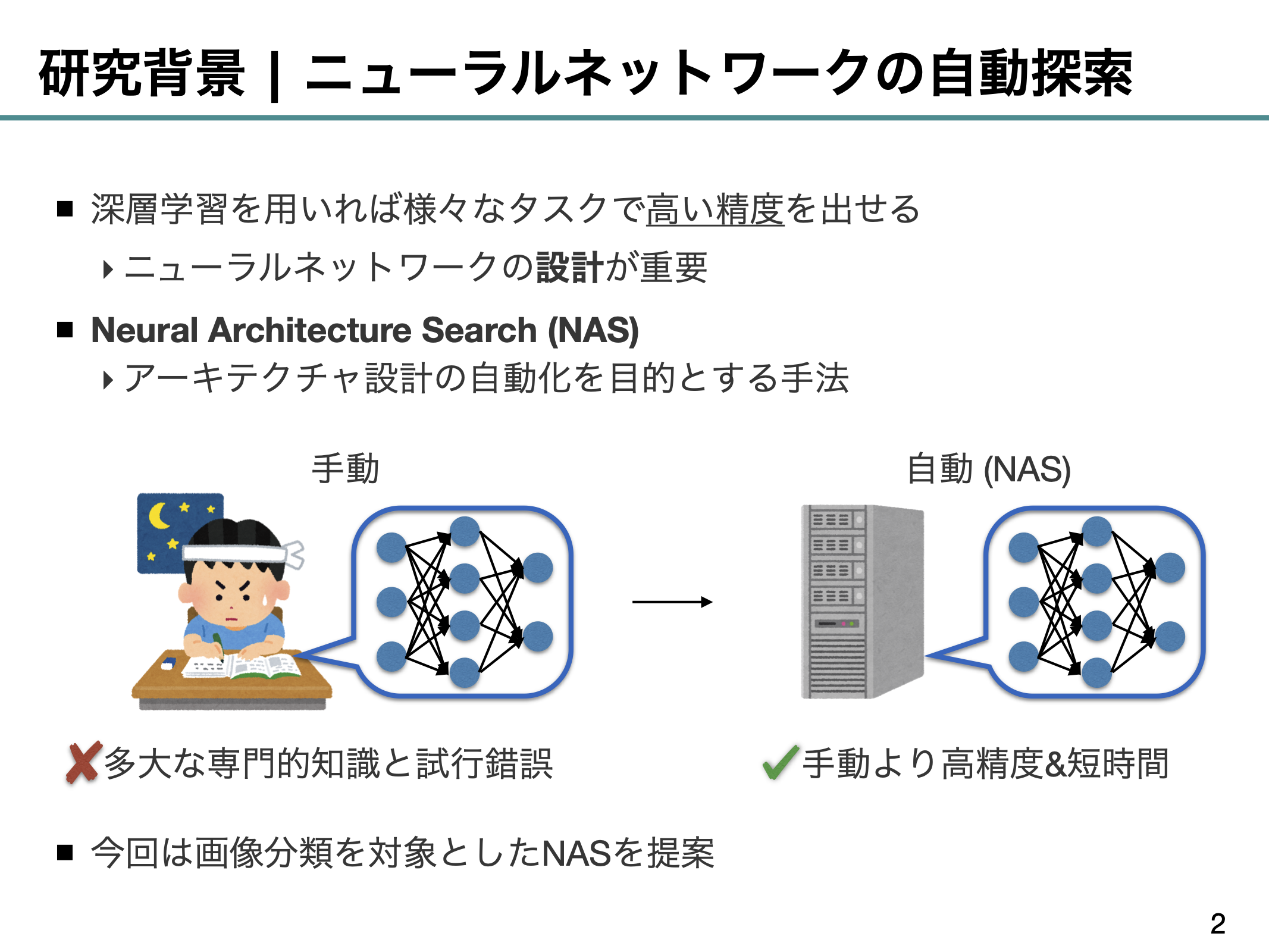

ニューラルネットワーク(NN)のアーキテクチャの設計を手動で行うには専門的知識と多大な労力を要する.

NNのアーキテクチャの設計を自動で行うニューラルアーキテクチャ探索(NAS)の分野の発達により,画像分類タスクにおいて高い精度を発揮するアーキテクチャを短時間で得られるようになってきている.

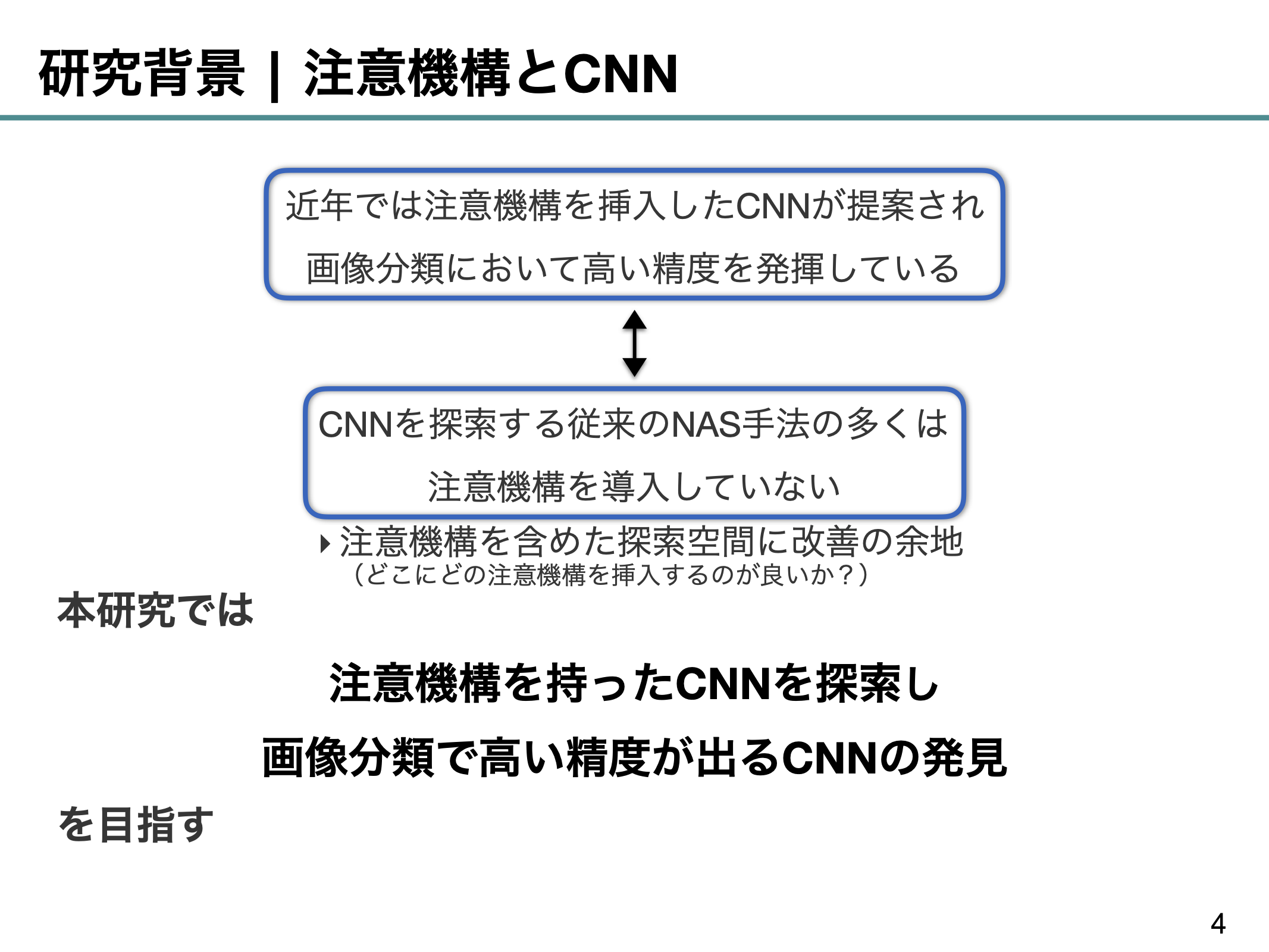

画像分類タスクにおいては一般的に畳み込みニューラルネットワーク(CNN)が用いられるが,その主要な演算は畳み込みとpoolingである.

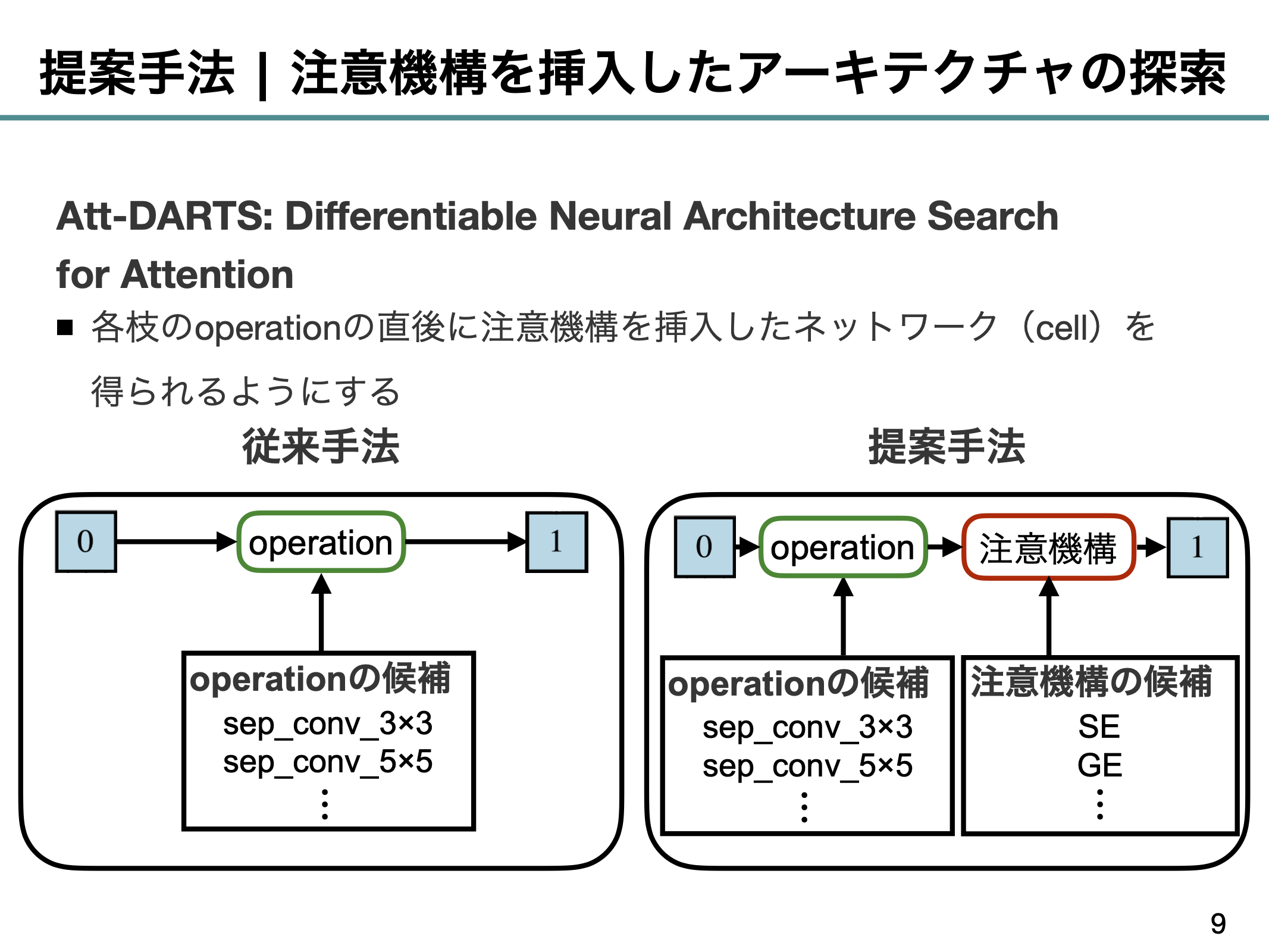

従来のNASの手法ではこれを考慮し,演算の選択肢として畳み込みとpoolingのみを含めている.

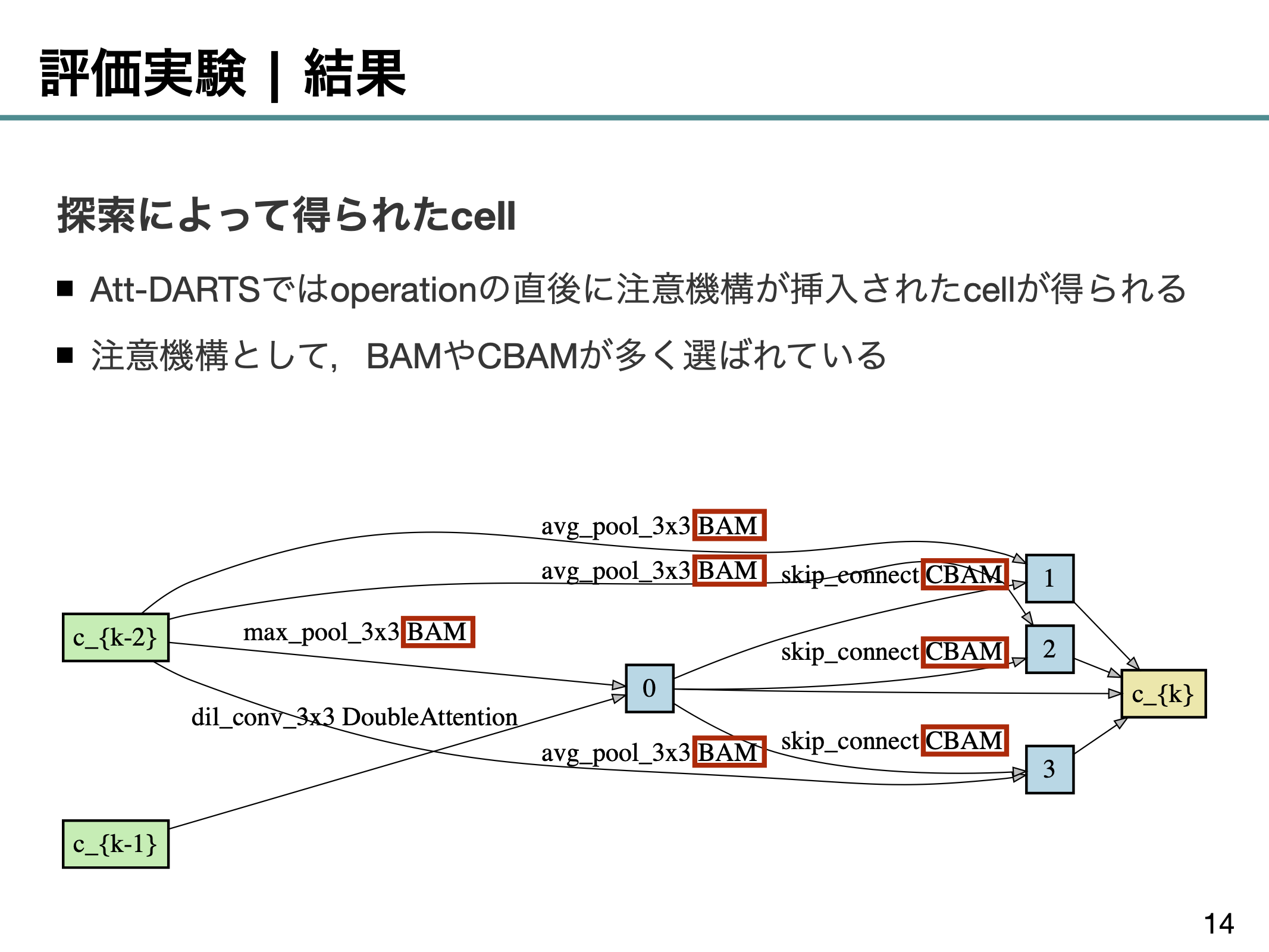

一方近年,画像認識の分野において,従来のCNNに新たに注意機構を挿入することでネットワークの表現力を向上させ,パラメータ数の増加量を抑えながらもより高い精度を発揮している.

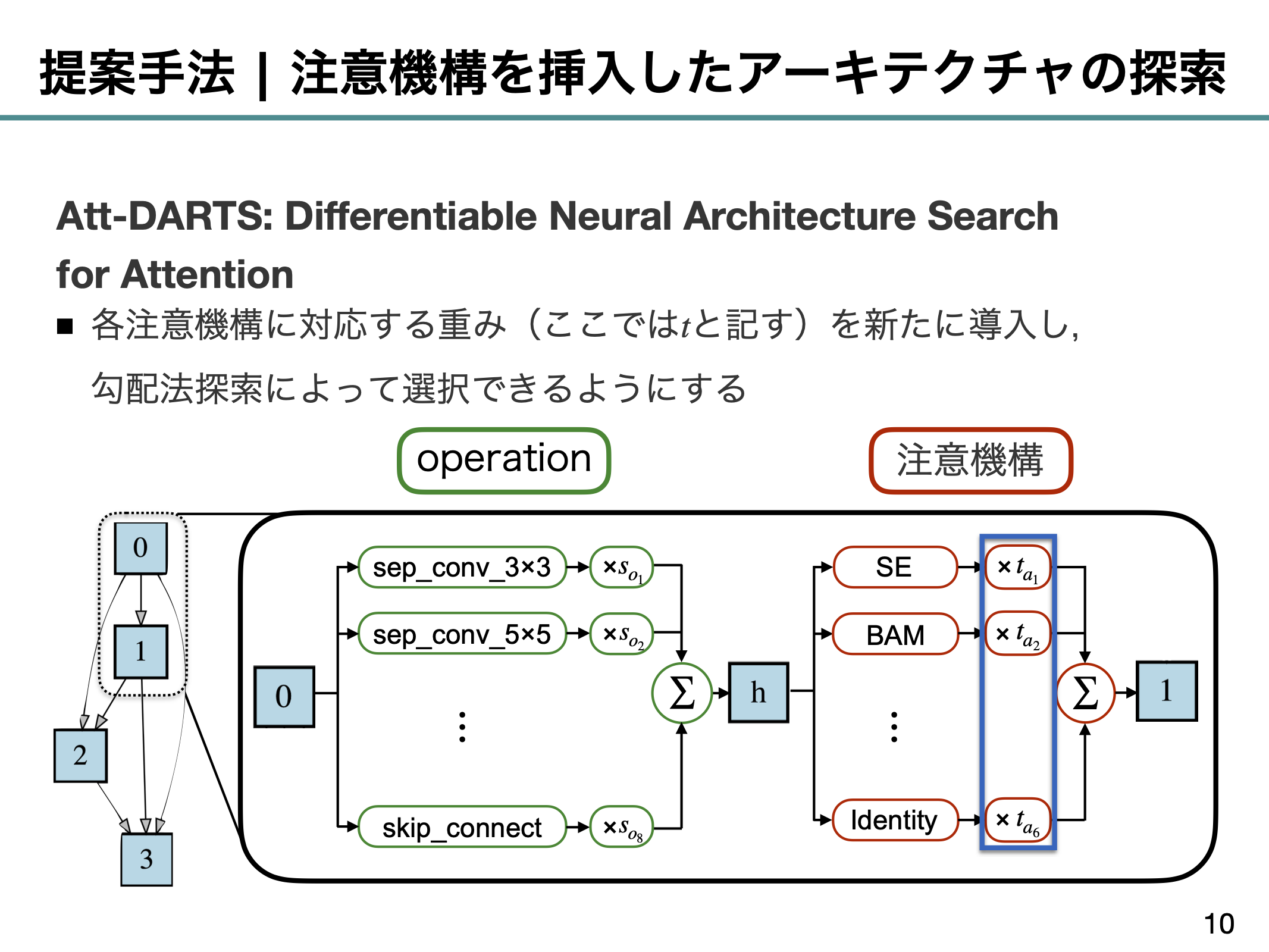

そこで本研究では,従来の畳込みなどの演算に加えて注意機構が挿入されたCNNを探索する手法を提案する.

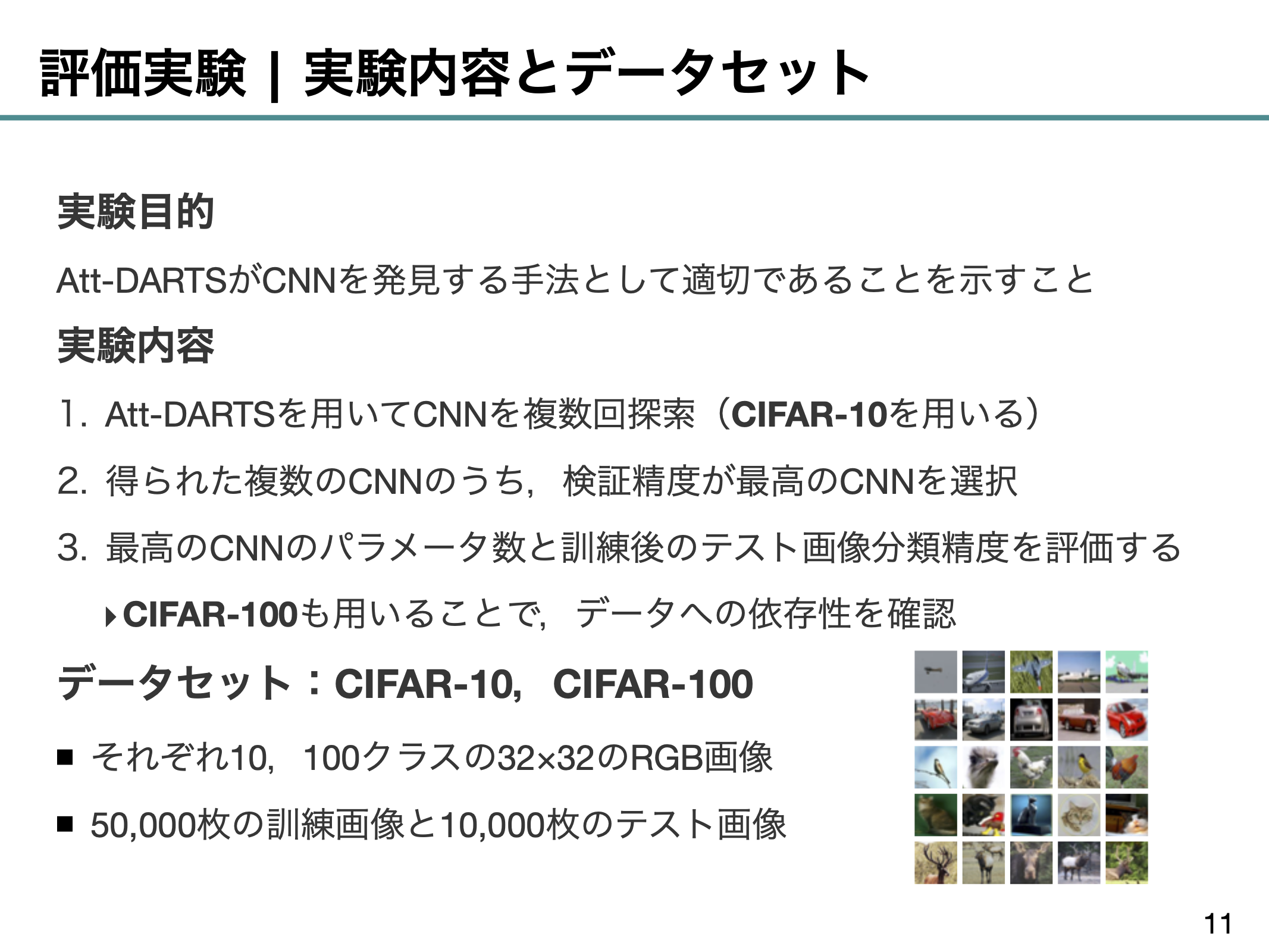

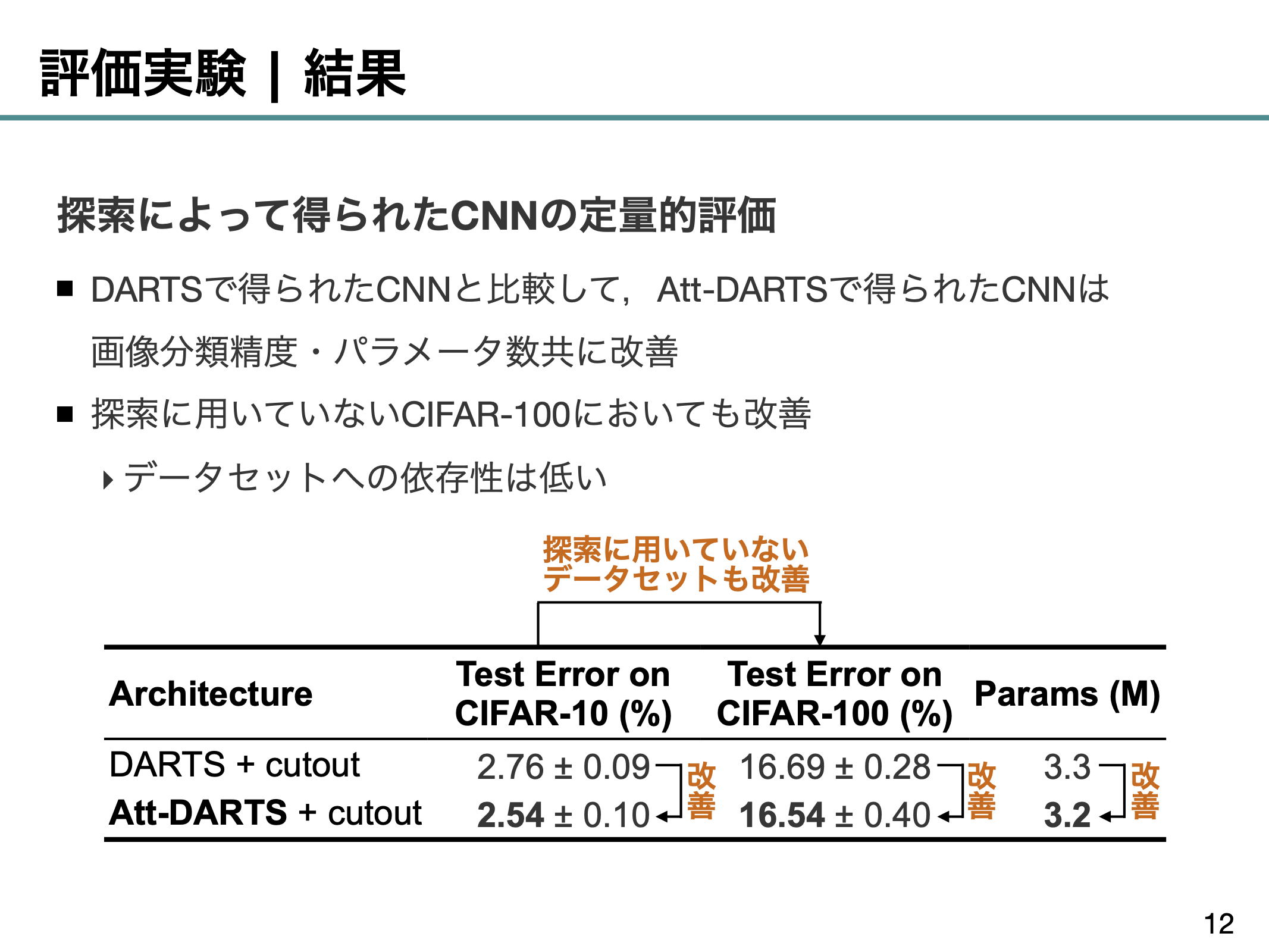

提案手法では勾配法で探索を行うDARTSをベースとし,得られたCNNはCIFAR-10及びCIFAR-100を用いた画像分類タスクにおいて,DARTSで得られたものよりパラメータ数を抑えつつも精度が向上した.

- Kohei Nakai, Takashi Matsubara, and Kuniaki Uehara, “Neural Architecture Search for Convolutional Neural Networks with Attention,” IEICE Transactions on Information and Systems, vol. E104.D, no. 2, 2021.

- Kohei Nakai, Takashi Matsubara, and Kuniaki Uehara, “Att-DARTS: Differentiable Neural Architecture Search for Attention,” Proc. of The 2020 International Joint Conference on Neural Networks (IJCNN2020), Glasgow (Online), Jul. 2020.